Dünya Ekonomik Forumu’na (WEF) nazaran çevrimiçi deepfake görüntülerin sayısı her yıl %900 oranında artıyor. Taciz, intikam ve kripto dolandırıcılığı ile ilgili raporlarla birlikte birçok kıymetli deepfake dolandırıcılık hadisesi haber manşetlerine çıktı. Kaspersky araştırmacıları, kullanıcıların dikkat etmesi gereken ve deepfake kullanan birinci üç dolandırıcılık planına ışık tutuyor.

Yapay hudut ağlarının, derin öğrenmenin ve münasebetiyle deepfake aldatma tekniklerinin kullanımı, dünyanın dört bir yanındaki kullanıcıların yüzlerini yahut bedenlerini dijital olarak değiştirmeye, böylelikle rastgele birinin diğer biri üzere göründüğü gerçekçi imaj, görüntü ve ses malzemelerini üretmeye imkan sağlıyor. Bu manipüle edilmiş görüntü ve manzaralar sıklıkla yanlış bilgi yaymak ve başka makus niyetli emellerle kullanılıyor.

Finansal dolandırıcılık

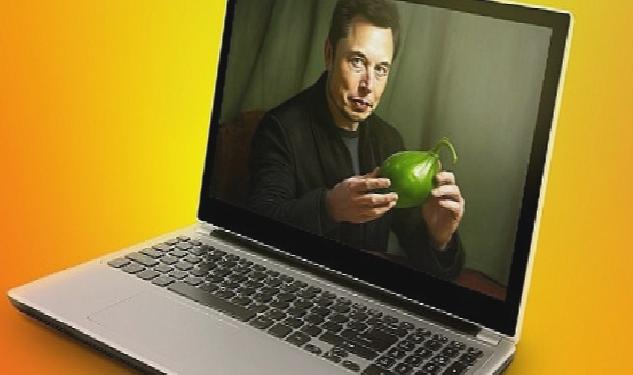

Deepfake’ler, hatalıların kurbanları tuzağa çekmek maksadıyla ünlüleri taklit etmek için geliştirdikleri imajların kullanıldığı toplumsal mühendislik tekniklerine bahis olabiliyor. Örneğin Elon Musk’ın kuşkulu bir kripto para yatırım planından yüksek getiri vaat eden yapay olarak oluşturulmuş bir videosu, geçen yıl süratle yayılarak kullanıcıların para kaybetmelerine neden oldu. Dolandırıcılar bunun üzere geçersiz görüntüler yaratmak için ünlülerin imgelerini kullanıyor, eski görüntüleri bir ortaya getiriyor ve toplumsal medya platformlarında canlı yayınlar başlatarak kendilerine gönderilen rastgele bir kripto para ödemesini iki katına çıkarma kelamı veriyor.

Pornografik deepfake

Deepfake’lerin bir öteki kullanım alanı da bireyin mahremiyetini ihlal etmek. Deepfake görüntüler, bir kişinin yüzünün pornografik bir görüntü üzerine yerleştirilmesiyle oluşturulabiliyor ve büyük ziyana ve ıstıraba neden olabiliyor. Bir olayda, kimi ünlülerin yüzlerinin müstehcen sahnelerdeki pornografik aktrislerin bedenlerine bindirildiği deepfake görüntülerinin internette yayıldığı ortaya çıktı. Sonuç olarak, bu çeşit olaylarda taarruz mağdurlarının prestijleri zedeleniyor ve hakları ihlal ediliyor.

İşe dair riskler

Çoğu vakit deepfake’ler şirket yöneticilerinden haraç alma, şantaj ve endüstriyel casusluk üzere hatalar için işletmeleri amaç almak üzere kullanılıyor. Örneğin, siber hatalılar bir ses deepfake’i kullanarak BAE’deki bir banka müdürünü kandırmayı ve 35 milyon dolar çalmayı başarmıştı. Kelam konusu hadisede ikna edici bir deepfake oluşturmak için işvereninin sesinin yalnızca küçük bir kaydının ele geçirilmesi kafiydi. Bir başka vakada, dolandırıcılar en büyük kripto para platformu Binance’i kandırmaya çalıştı. Binance yöneticisi, hiç katılmadığı bir Zoom toplantısı hakkında “Teşekkür ederim!” iletileri almaya başladığında şaşırdı. Saldırganlar, yöneticinin herkese açık imajlarıyla bir deepfake oluşturmayı ve bunu çevrimiçi bir toplantıda yönetici ismine konuşarak uygulamayı başardılar.

FBI, insan kaynakları yöneticilerini uyarıyor!

Genel olarak, deepfake’leri kullanan dolandırıcıların maksatları ortasında dezenformasyon ve kamuoyunu manipüle etme, şantaj ve casusluk yer alıyor. Bir FBI uyarısına göre, insan kaynakları yöneticileri uzaktan çalışmak için başvuran adaylar tarafından deepfake kullanımı konusunda zati tetikte bekliyor. Binance olayında, saldırganlar deepfake oluşturmak için internetten gerçek şahısların manzaraları kullandılar ve hatta bu şahısların fotoğraflarını özgeçmişlere eklediler. İnsan kaynakları yöneticilerini bu biçimde kandırmayı başarırlarsa ve sonrasında bir teklif alırlarsa, devamında patron bilgilerini çalabiliyorlar.

Deepfake’ler büyük bir bütçe gerektiren ve sayıları giderek artan kıymetli bir dolandırıcılık çeşidi olmaya devam ediyor. Kaspersky tarafından daha evvel yapılan bir araştırma, darknet üzerindeki deepfake’lerin maliyetini ortaya koyuyor. Sıradan bir kullanıcı internette bir yazılım bulur ve bir deepfake yapmaya çalışırsa, sonuç gerçekçi olmayacak ve sahtekarlık bariz oluyor. Çok az insan düşük kaliteli bir deepfake’e inanıyor. Yüz sözündeki gecikmeleri yahut çene biçimindeki bulanıklığı çabucak fark edebiliyor.

Bu nedenle, siber hatalılar bir taarruza hazırlanırken büyük ölçüde dataya muhtaçlık duyuyor. Taklit etmek istedikleri kişinin fotoğrafları, görüntüleri ve sesleri üzere. Farklı açılar, ışık parlaklığı, yüz sözleri, hepsi en son kalitede büyük rol oynuyor. Sonucun gerçekçi olması için aktüel bir bilgisayarın gücü ve yazılımı gerekiyor. Tüm bunlar büyük ölçüde kaynak gerektiriyor ve bu kaynağa sırf az sayıda siber hatalı erişebiliyor. Bu nedenle deepfake sağlayabileceği tehlikelere karşın hala son derece az bir tehdit olmaya devam ediyor ve sadece az sayıda alıcı bunu karşılayabiliyor. Sonuç olarak bir dakikalık bir “deepfake’in fiyatı 20 bin ABD dolarından başlıyor.

“Bazen prestij riskleri çok önemli sonuçlar doğurabilir”

Kaspersky’de Kıdemli Güvenlik Uzmanı Dmitry Anikin, şunları söylüyor: “Deepfake’in işletmeler için oluşturduğu en önemli tehditlerden biri her vakit kurumsal bilgilerin çalınması değildir. Bazen prestij riskleri çok önemli sonuçlar doğurabilir. Yöneticinizin (görünüşe göre) hassas bahislerde kutuplaştırıcı açıklamalar yaptığı bir görüntünün yayınlandığını düşünün. Şirket için bu durum pay fiyatlarında süratli bir düşüşe yol açabilir. Lakin, bu türlü bir tehdidin riskleri son derece yüksek olmasına karşın, deepfake oluşturmanın maliyeti ve çok az saldırganın yüksek kaliteli bir deepfake oluşturabilmesi nedeniyle bu formda hücuma uğrama talihiniz son derece düşüktür. Bu hususta yapabileceğiniz şey, deepfake görüntülerin temel özelliklerinin farkında olmak ve size gelen sesli bildiri ve görüntülere kuşkuyla yaklaşmaktır. Ayrıyeten, çalışanlarınızın deepfake’in ne olduğunu ve nasıl fark edebileceklerini anladıklarından emin olun. Örneğin sarsıntılı hareket, cilt tonunda kaymalar, garip göz kırpma yahut hiç göz kırpmama üzere işaretler belirleyici olacaktır.”

Darknet kaynaklarının daima olarak izlenmesi, deepfake sanayisi hakkında kıymetli bilgiler sağlayarak araştırmacıların bu alandaki tehdit aktörlerinin en son eğilimlerini ve faaliyetlerini takip etmelerine imkan sağlıyor. Araştırmacılar darknet’i izleyerek deepfake’lerin oluşturulması ve dağıtımı için kullanılan yeni araçları, hizmetleri ve pazar yerlerini ortaya çıkarabiliyor. Bu cins bir izleme, deepfake araştırmasının kritik bir bileşenini oluşturuyor ve gelişen tehdit ortamına ait anlayışımızı geliştirmemize yardımcı oluyor. Kaspersky Dijital Ayak İzi İstihbaratı hizmeti, müşterilerinin deepfake ile ilgili tehditler kelam konusu olduğunda bir adım önde olmalarına yardımcı olmak için bu çeşit bir izleme içeriyor.

Kaspersky Daily’de deepfake sanayisi hakkında daha fazla bilgi edinebilirsiniz.

Kaspersky, deepfake’lerle ilgili tehditlerden korunmak için şunları öneriyor:

Kaynak: (BYZHA) Beyaz Haber Ajansı

POLİTİKA

19 Nisan 2025EKONOMİ

19 Nisan 2025GÜNDEM

19 Nisan 2025SPOR

19 Nisan 2025EKONOMİ

19 Nisan 2025SAĞLIK

19 Nisan 2025EKONOMİ

19 Nisan 2025Veri politikasındaki amaçlarla sınırlı ve mevzuata uygun şekilde çerez konumlandırmaktayız. Detaylar için veri politikamızı inceleyebilirsiniz.